Cơ bản

Giao ngay

Giao dịch tiền điện tử một cách tự do

Giao dịch ký quỹ

Tăng lợi nhuận của bạn với đòn bẩy

Chuyển đổi và Đầu tư định kỳ

0 Fees

Giao dịch bất kể khối lượng không mất phí không trượt giá

ETF

Sản phẩm ETF có thuộc tính đòn bẩy giao dịch giao ngay không cần vay không cháy tải khoản

Giao dịch trước giờ mở cửa

Giao dịch token mới trước niêm yết

Futures

Truy cập hàng trăm hợp đồng vĩnh cửu

TradFi

Vàng

Một nền tảng cho tài sản truyền thống

Quyền chọn

Hot

Giao dịch với các quyền chọn kiểu Châu Âu

Tài khoản hợp nhất

Tối đa hóa hiệu quả sử dụng vốn của bạn

Giao dịch demo

Giới thiệu về Giao dịch hợp đồng tương lai

Nắm vững kỹ năng giao dịch hợp đồng từ đầu

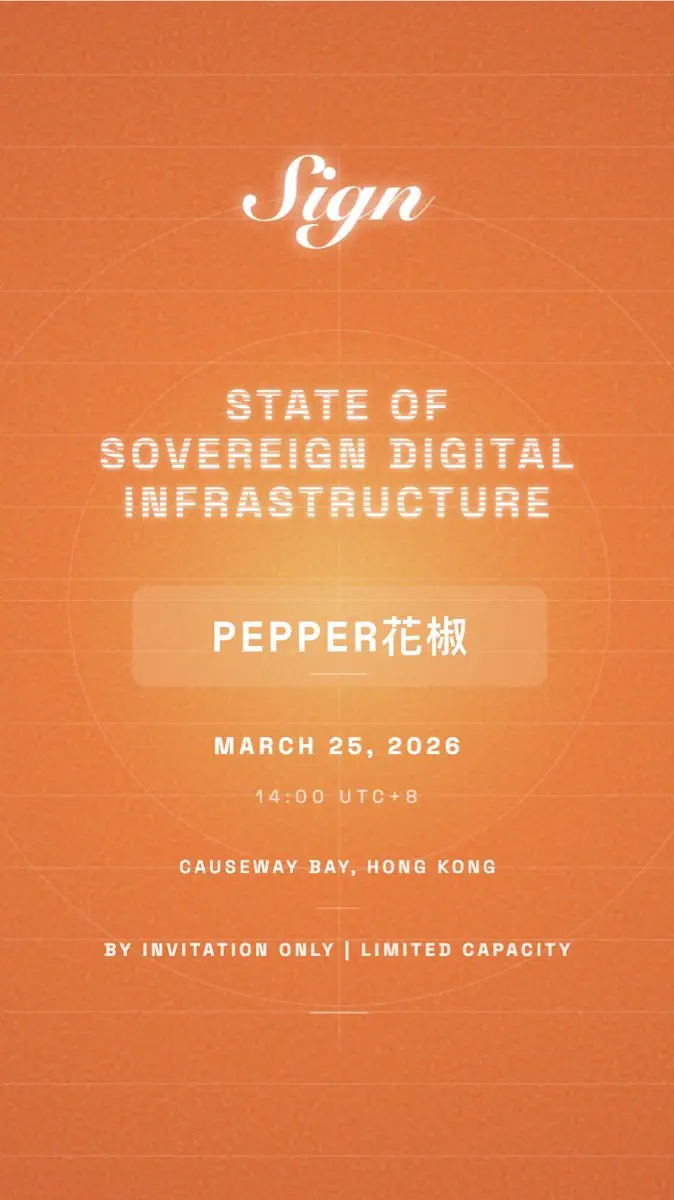

Sự kiện tương lai

Tham gia sự kiện để nhận phần thưởng

Giao dịch demo

Sử dụng tiền ảo để trải nghiệm giao dịch không rủi ro

Launch

CandyDrop

Sưu tập kẹo để kiếm airdrop

Launchpool

Thế chấp nhanh, kiếm token mới tiềm năng

HODLer Airdrop

Nắm giữ GT và nhận được airdrop lớn miễn phí

Launchpad

Đăng ký sớm dự án token lớn tiếp theo

Điểm Alpha

Giao dịch trên chuỗi và nhận airdrop

Điểm Futures

Kiếm điểm futures và nhận phần thưởng airdrop

Đầu tư

Simple Earn

Kiếm lãi từ các token nhàn rỗi

Đầu tư tự động

Đầu tư tự động một cách thường xuyên.

Sản phẩm tiền kép

Kiếm lợi nhuận từ biến động thị trường

Soft Staking

Kiếm phần thưởng với staking linh hoạt

Vay Crypto

0 Fees

Thế chấp một loại tiền điện tử để vay một loại khác

Trung tâm cho vay

Trung tâm cho vay một cửa