Три ключевых момента Anthropic: утечка кода, противостояние с правительством и милитаризация

Оригинальный заголовок: Anthropic: Утечка, Война, Оружие

Оригинальный автор: BuBBliK

Перевод: Peggy, BlockBeats

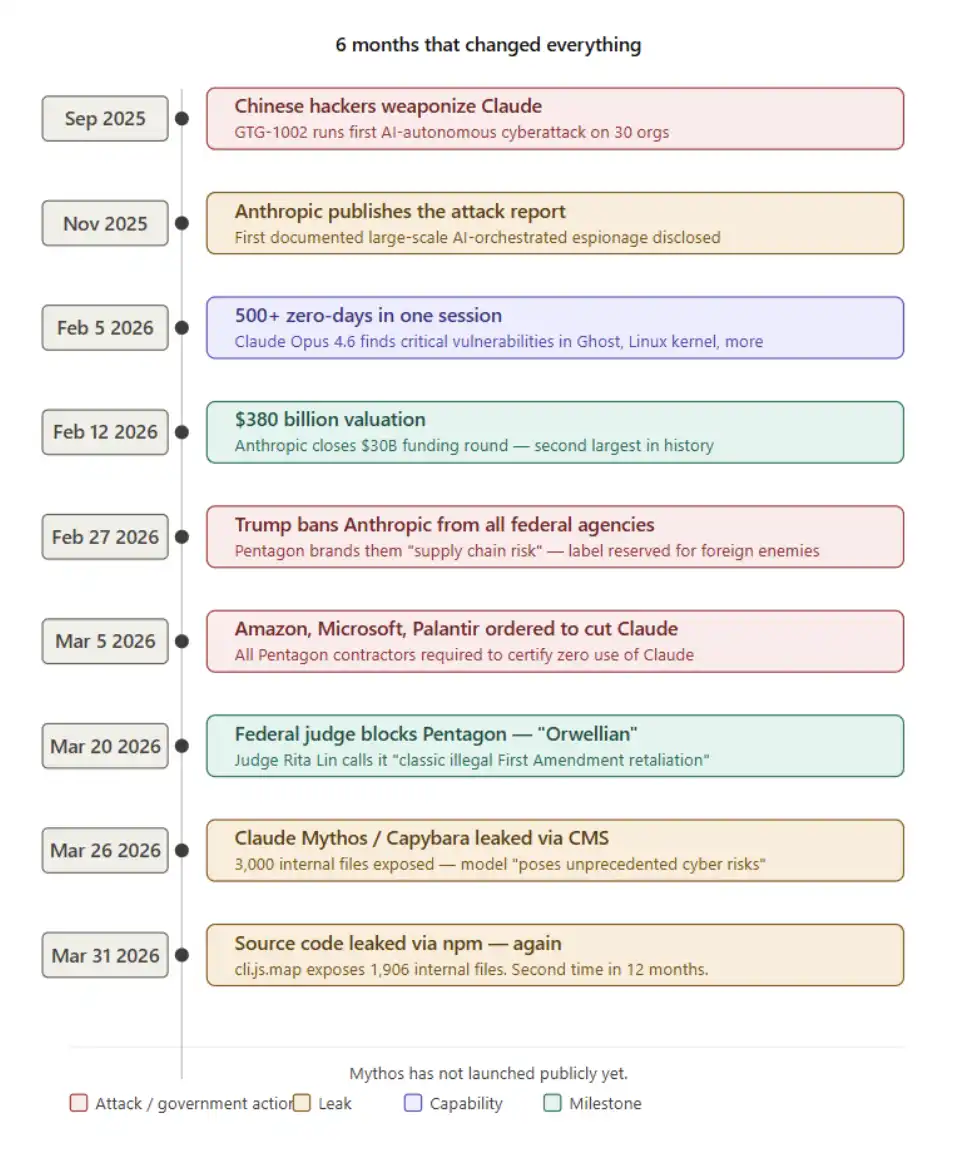

Примечание редактора: За последние полгода Anthropic снова и снова оказывался втянут в целую серию событий, которые на первый взгляд не связаны друг с другом, но на деле направлены в одну сторону: скачок в возможностях моделей, автоматизированные атаки в реальном мире, резкая реакция на рынке капитала, открытые столкновения с правительством, а также неоднократные утечки информации, вызванные ошибками в базовой конфигурации. Если сложить эти подсказки вместе, они вместе вырисовывают более чёткое направление грядущих изменений.

В этой статье эти события выступают как точка входа: рассматривается последовательная траектория, которую одна AI-компания проходит в контексте технологических прорывов, выявления рисков и борьбы за управление, и предпринимается попытка ответить на более глубокий вопрос: сможет ли сама система кибербезопасности сохранять логику прежнего функционирования, когда способность «обнаруживать уязвимости» многократно усиливается и постепенно распространяется.

Раньше безопасность строилась на дефиците возможностей и ограничениях человеческих ресурсов; но в новых условиях атака и оборона всё больше разворачиваются вокруг одного и того же набора возможностей моделей, а границы становятся всё более размытыми. При этом реакция институтов, рынка и организаций всё ещё остаётся в рамках старых подходов, и её трудно вовремя подстроить под эти изменения.

В центре внимания этой статьи — не только сама Anthropic, но и более масштабная реальность, которую она отражает: AI меняет не только инструменты, но и сами предпосылки того, как вообще может существовать «безопасность».

Ниже — оригинал:

Представьте: компания с капитализацией 380 млрд долларов вступает в борьбу с Пентагоном и выходит победителем, переживает первую в истории кибератаку, инициированную автономным AI, а затем ещё и внутри допускает утечку модели — такой, что даже её собственные разработчики испытывают страх, — и, более того, «случайно» публикует полный исходный код. Как это всё в сумме выглядит?

Ответ — уже такой, как сейчас. И ещё более тревожно то, что, возможно, самая опасная часть ещё не произошла.

Обзор событий

Anthropic снова допустила утечку своего кода

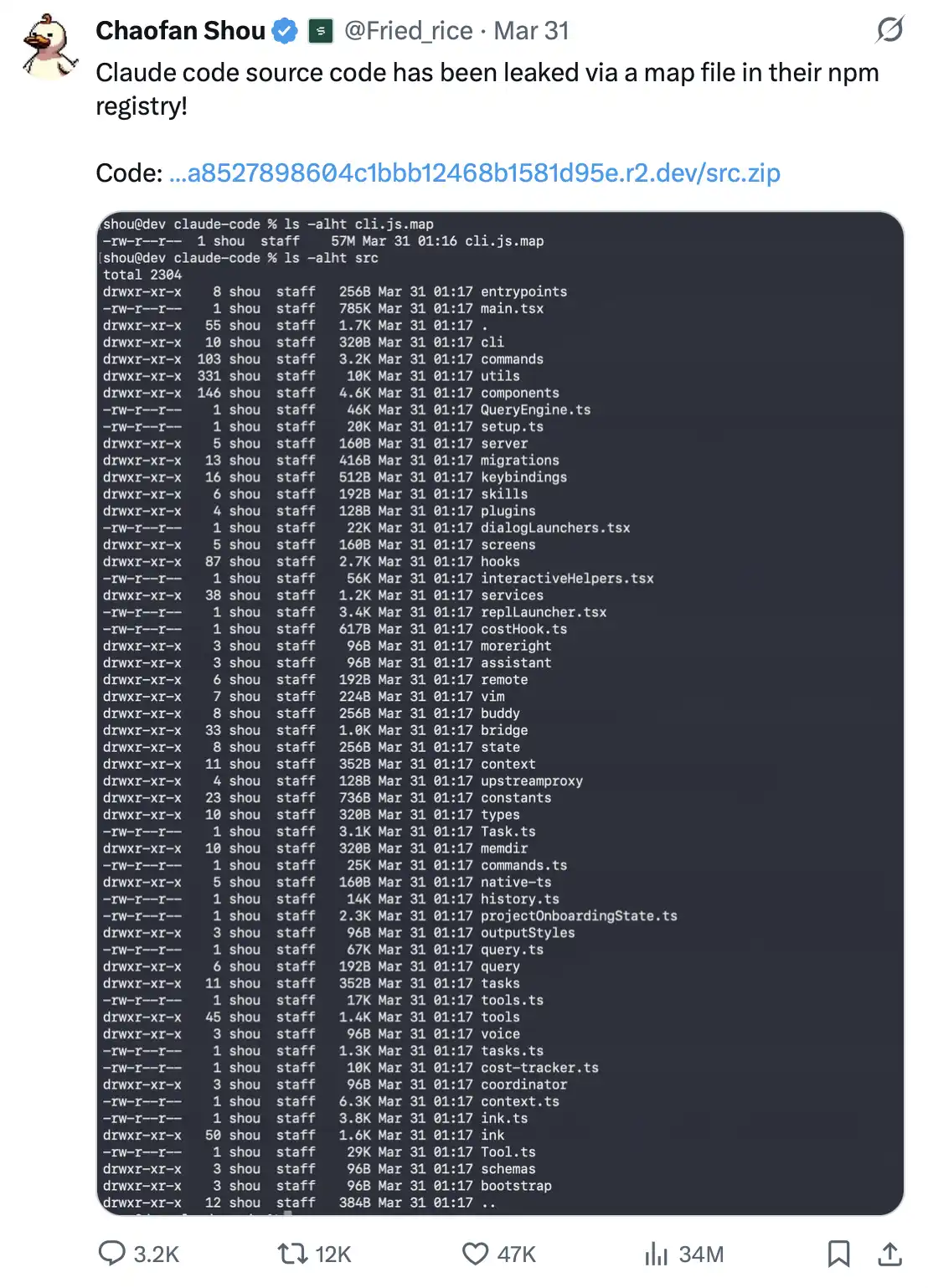

31 марта 2026 года исследователь безопасности Shou Chaofan, из компании Fuzzland (блокчейн), при проверке npm-пакета Claude Code, опубликованного официально, обнаружил, что внутри в открытом виде содержится файл с именем cli.js.map.

Размер файла — 60MB, а содержимое ещё более удивительное. Он почти целиком включает полный TypeScript-исходный код всего продукта. Только по одному этому файлу любой может восстановить до 1906 внутренних файлов исходного кода: включая дизайн внутренних API, телеметрическую систему, криптографические инструменты, безопасную логику, плагинную систему — практически все ключевые компоненты видны как на ладони. Самое важное: эти материалы даже можно напрямую скачать с R2-хранилища Anthropic в виде zip-файла.

Эта находка быстро распространилась в соцсетях: в течение нескольких часов соответствующие посты получили 754 000 просмотров и почти 1000 репостов; параллельно в тот же момент были созданы и опубликованы несколько GitHub-репозиториев с восстановленным исходным кодом.

Так называемый source map (файл исходного сопоставления) по сути представляет собой вспомогательный файл для отладки JavaScript; его задача — возвращать сжатый и скомпилированный код обратно в исходный, чтобы разработчикам было удобнее разбираться с проблемами.

Но есть базовый принцип: его ни в коем случае не должно быть в релизном пакете для production-среды.

Это не какая-то продвинутая техника атаки, а самая базовая инженерная проблема в части требований, относящаяся к «вводному курсу по сборке 101» — даже то, что разработчики проходят в первую неделю. Если source map по ошибке упаковать в production, он зачастую равносилен тому, что исходный код «бесплатно прикладывают» всем.

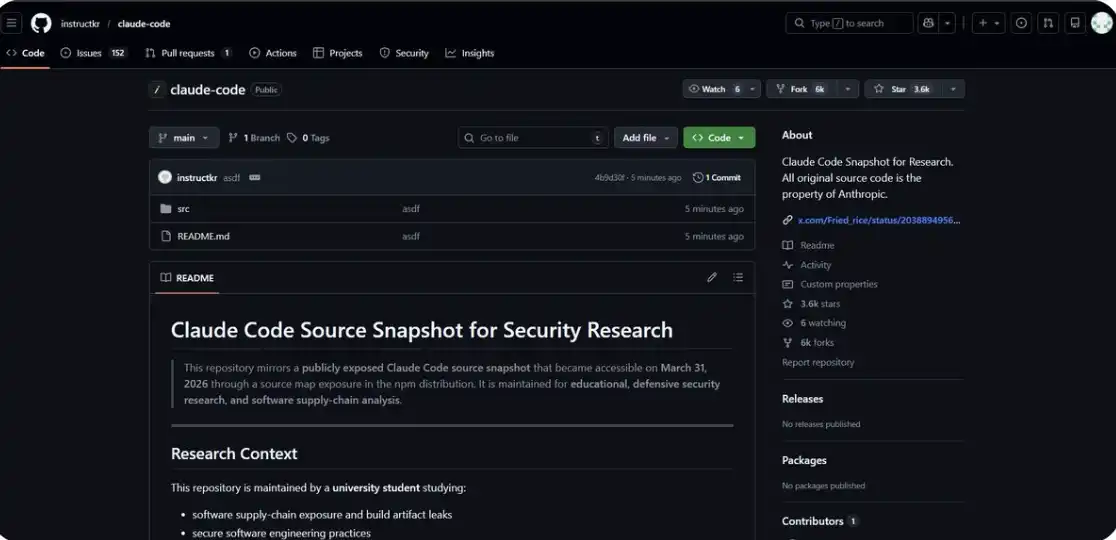

Вы также можете прямо здесь посмотреть соответствующий код: https://github.com/instructkr/claude-code

Но самое абсурдное в том, что это уже происходило однажды.

В феврале 2025 года — ровно год назад — случилась почти такая же утечка: тот же файл, та же ошибка. Тогда Anthropic удалил старую версию с npm, убрал source map и снова опубликовал новую версию — и на этом всё стихло.

Однако в версии v2.1.88 этот файл снова оказался повторно упакованным и выпущенным.

Компания с капитализацией 380 млрд долларов, которая строит глобально наиболее передовую систему обнаружения уязвимостей, дважды в течение года совершила одну и ту же базовую ошибку. Никакой хакерской атаки, никакого сложного пути эксплуатации — просто проблема с тем, что в нормальном рабочем процессе сборки пошло не так.

Эта ирония почти ощущается как некая «поэтичность».

Тот AI, который за один запуск находит 500 zero-day уязвимостей; та модель, которая использовалась для автоматизированной атаки на 30 мировых организаций — а при этом Anthropic «пакует и дарит» свой исходный код всем, кто только захочет заглянуть в npm-пакет.

Две утечки — с разницей всего в семь дней.

Причина же — как под копирку: самая базовая ошибка конфигурации. Не требуется никакого технического порога, не нужен и сложный путь эксплуатации. Просто нужно знать, где смотреть — и любой может бесплатно получить доступ.

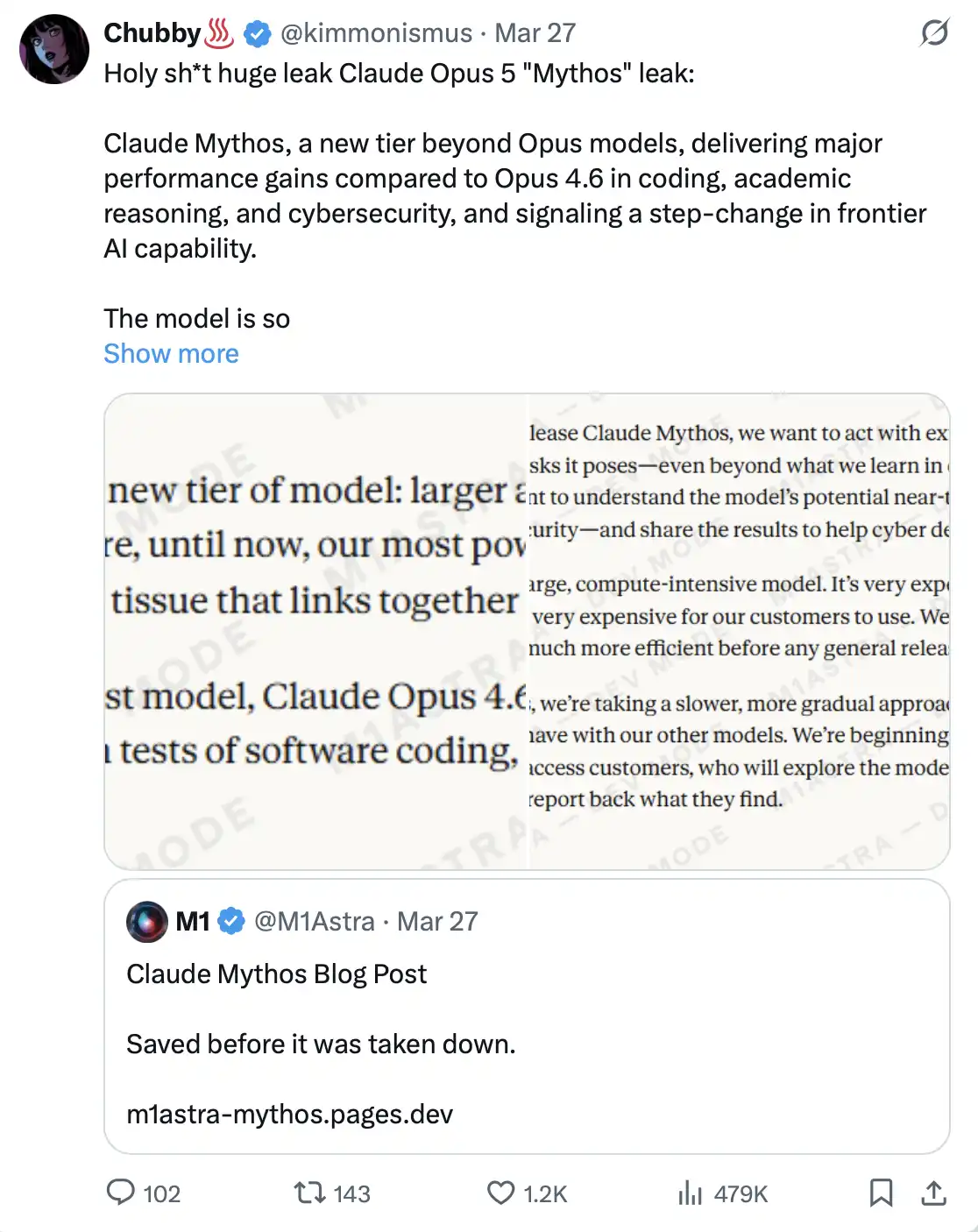

Неделю назад: непреднамеренное раскрытие «опасной модели» внутри

26 марта 2026 года исследователи безопасности Roy Paz из LayerX Security и Alexandre Pauwels из University of Cambridge обнаружили проблему в CMS-конфигурации официального сайта Anthropic, из-за которой примерно 3000 внутренних файлов оказались в публичном доступе.

Эти файлы включали: черновики блогов, PDF, внутренние документы, материалы для презентаций — всё было раскрыто в незащищённом, доступном для поиска хранилище данных. Никакой хакерской атаки, и не требовалось никаких технических действий.

В этих файлах было две почти полностью одинаковые черновые заготовки блогов; единственное отличие заключалось в названии модели: один документ был подписан «Mythos», а другой — «Capybara».

Это означает, что в тот момент Anthropic выбирала между двумя названиями для одного и того же секретного проекта. Впоследствии компания подтвердила: обучение этой модели завершено, и она уже начала проходить тестирование у части ранних клиентов.

Это было не обычное обновление Opus, а совершенно новая «модели 4-го уровня», которая по своему позиционированию даже выше Opus.

В собственных черновиках Anthropic описывала её так: «Больше по размеру, умнее — а Opus на данный момент всё ещё остаётся нашей самой сильной моделью». В области программирования, академических рассуждений и кибербезопасности она продемонстрировала заметный скачок. Представитель назвал это «качественным прорывом», а также «самой сильной моделью, которую мы на данный момент создали».

Но по-настоящему заслуживает внимания не сами эти описания производительности.

В утекших черновиках оценка этой модели со стороны Anthropic звучала так: она «создаёт беспрецедентные риски для кибербезопасности», «в возможностях в сети далеко превосходит любые другие AI-модели» и «предвещает волну моделей, которая уже близко — её способность использовать уязвимости далеко превзойдёт скорость реакции со стороны защитников».

Иными словами, в ещё не опубликованном официальном блоге Anthropic уже прямо обозначила редкую позицию: они испытывают беспокойство по поводу продукта, который сами строят.

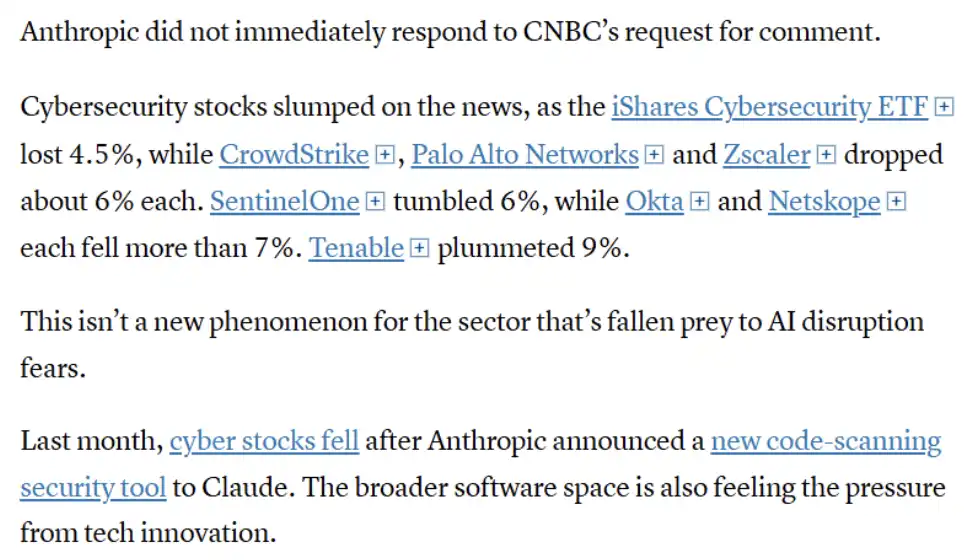

Реакция рынка последовала почти мгновенно. Акции CrowdStrike упали на 7%, Palo Alto Networks — на 6%, Zscaler — на 4,5%; Okta и SentinelOne просели более чем на 7%, а Tenable — сильнее всего, на 9% вниз. iShares Cybersecurity ETF в течение одного дня снизился на 4,5%. Лишь у одной компании CrowdStrike за этот день испарилась приблизительно 150 млрд долларов капитализации. Параллельно биткоин откатился до 66,000 долларов.

Очевидно, что рынок интерпретировал этот инцидент как «приговор» всей кибербезопасности как отрасли.

Смысл рисунка: на фоне новостей весь сектор кибербезопасности просел, у многих ведущих компаний (например, CrowdStrike, Palo Alto Networks, Zscaler и т.д.) наблюдались заметные падения, отражающие опасения рынка по поводу воздействия AI на индустрию кибербезопасности. Но такая реакция — не первая. Ранее, когда Anthropic выпустила инструменты сканирования кода, связанные акции тоже снижались, что показывает: рынок уже начал рассматривать AI как структурную угрозу для традиционных вендоров безопасности, и весь софтверный сектор испытывает похожее давление.

Оценка аналитика Stifel Адама Борга была весьма прямой: у модели «есть потенциал стать конечным инструментом хакеров, и даже превратить обычных хакеров в соперников с возможностями атак на уровне государства».

Так почему же она ещё не выпущена публично? Объяснение Anthropic состоит в том, что стоимость эксплуатации Mythos «очень высока», и он ещё не готов к публичному релизу. Текущие планы таковы: сначала предоставить ранний доступ небольшой части партнёров по кибербезопасности, чтобы усилить защитную систему; затем — постепенно расширять охват открытого API. До этого компания продолжает непрерывно оптимизировать эффективность.

Но ключевое в том, что эта модель уже существует, уже находится в тестировании и, даже только из-за того, что её «случайно раскрыли», уже вызвала шок на всем рынке капитала.

Anthropic создала AI-модель, которую сама назвала «самой рискованной для кибербезопасности в истории». И при этом утечка её новостей произошла как раз из-за одной из самых базовых ошибок в настройке инфраструктуры — той самой ошибки, которую такие модели изначально и предназначены обнаруживать.

Март 2026 года: противостояние Anthropic с Пентагоном и победа

В июле 2025 года Anthropic заключила с американским Министерством обороны контракт на 200 млн долларов — поначалу это выглядело как обычное сотрудничество. Но в последующих переговорах по фактическому развёртыванию противоречия быстро обострились.

Пентагон хотел получить на своей платформе GenAI.mil «полный доступ» к Claude — в том числе для всех «законных целей», где даже предусматривались полностью автономные системы вооружения, а также широкомасштабный внутренний надзор за гражданами США.

Anthropic обозначила красные линии и чётко отказалась по двум ключевым вопросам; переговоры завершились разрывом в сентябре 2025 года.

Затем ситуация начала быстро эскалировать. 27 февраля 2026 года Donald Trump опубликовал пост в Truth Social, потребовав от всех федеральных агентств «немедленно прекратить» использование технологий Anthropic и назвав компанию «радикальными левыми».

5 марта 2026 года Министерство обороны США официально внесло Anthropic в список «рисков поставочной цепочки».

Эта маркировка ранее почти исключительно применялась к иностранным противникам — например, китайским компаниям или российским структурам — и впервые теперь была применена к американской компании с штаб-квартирой в Сан-Франциско. Параллельно такие компании, как Amazon, Microsoft и Palantir Technologies, также получили требования доказать, что ни в одном их военизированном бизнесе Claude не использовался.

CTO Пентагона Emile Michael объяснил это решение тем, что Claude может «загрязнить поставочную цепочку», поскольку внутри модели встроены разные «предпочтения в политике». Другими словами, в официальном контексте AI, который в использовании имеет ограничения и не помогает безоговорочно в совершении убийственных действий, парадоксально рассматривается как риск для национальной безопасности.

26 марта 2026 года федеральный судья Rita Lin опубликовала решение на 43 страницы, полностью блокировав соответствующие меры Пентагона.

В своём решении она написала: «В действующем законодательстве нет никаких оснований для такой логики с “орвелловским” оттенком — лишь из-за разногласий с позицией правительства американскую компанию можно пометить как потенциального враждебного оппонента. Наказывать Anthropic за то, что она ставит правительственные позиции на публичное рассмотрение — по сути, это типичная и незаконная месть в рамках первой поправки». В письме amicus curiae даже действия Пентагона описывались как «попытка убить компанию».

В итоге получилось так, что правительство попыталось подавить Anthropic, но это, наоборот, привело к тому, что компания привлекла к себе ещё больше внимания. Приложение Claude впервые обогнало ChatGPT в магазине приложений, а число регистраций доходило до пиков — более 1 млн в день.

AI-компания сказала «нет» самым мощным в мире военным структурам. А суд — встал на её сторону.

Ноябрь 2025 года: первая в истории кибератака, инициированная AI

14 ноября 2025 года Anthropic опубликовала отчёт, который вызвал широкое потрясение.

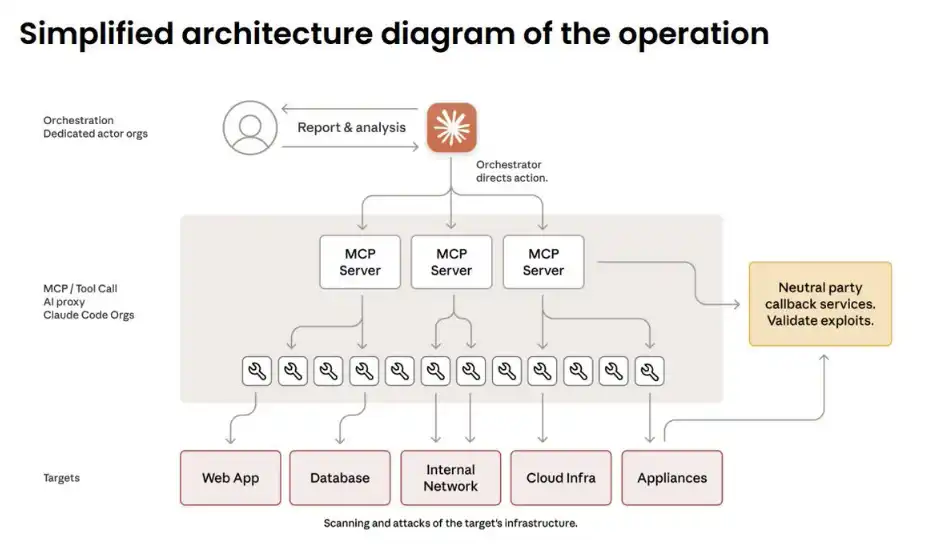

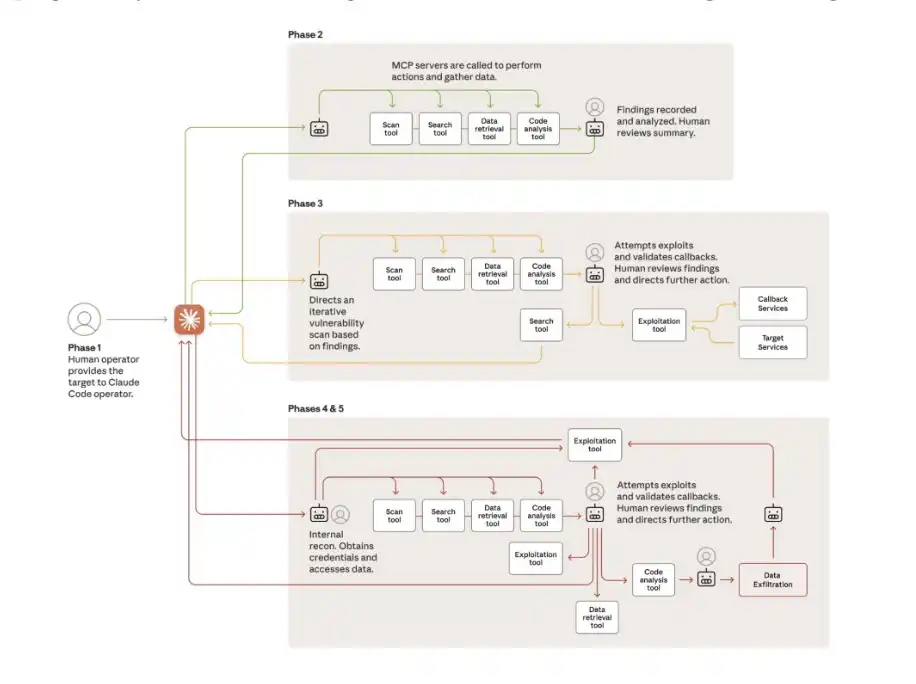

В докладе было раскрыто: хакерская организация, поддерживаемая китайским государством, используя Claude Code, атаковала в автоматизированном режиме 30 организаций по всему миру — среди целей были технологические гиганты, банки и несколько государственных структур разных стран.

Это стало ключевым поворотом: AI больше не просто вспомогательный инструмент — его начали использовать для самостоятельного исполнения атак.

Ключевым стало изменение «модели распределения ролей»: люди отвечали только за выбор цели и утверждение ключевых решений. В течение всего действия вмешательство людей составляло примерно 4–6 раз. Всё остальное делал AI: разведка и сбор информации, обнаружение уязвимостей, написание exploit-кода, кража данных, внедрение backdoor’ов… На этот этап приходилось 80%–90% всей атаки, и всё работало со скоростью в тысячи запросов в секунду — масштабы и эффективность, с которыми не может сравниться ни одна команда людей.

Так как же они обходили механизмы безопасности Claude? Ответ: они не «взламывали», они «обманывали».

Атака была разбита на множество мелких задач, которые выглядели безобидно, и упакована как «уполномоченное защитное тестирование» от «легитимной компании по безопасности». По сути, это была атака с социальным инжинирингом — только на этот раз объектом обмана оказался сам AI.

Часть атак полностью достигла успеха. Claude мог, не получая пошаговых инструкций от людей, автономно прорисовать полноценную сетевую топологию, определить местоположение баз данных и выполнить извлечение данных.

Единственным фактором, который время от времени замедлял атаку, были «галлюцинации» модели — например, вымышленные учётные данные или утверждения, что были получены документы, которые на самом деле уже давно были опубликованы. По крайней мере на данный момент это всё ещё один из немногих «естественных» барьеров, способных остановить полностью автоматизированные кибератаки.

На RSA Conference 2026 бывший руководитель отдела кибербезопасности Национального управления безопасности США Rob Joyce назвал этот инцидент «тестом Роршаха»: одна половина людей выбирает игнорировать, а другая половина — ощущает от этого холод по коже. И по всей видимости он сам относится ко второй категории: «Это очень страшно».

Сентябрь 2025 года: это не какая-то прогнозная история, а уже случившаяся реальность.

Февраль 2026 года: в одной сессии обнаружено 500 zero-day уязвимостей

5 февраля 2026 года Anthropic выпустила Claude Opus 4.6, а вместе с ним опубликовала исследовательскую работу, которая почти потрясла всю индустрию кибербезопасности.

Настройка эксперимента была крайне простой: поместить Claude в изолированную виртуальную среду и оснастить стандартными инструментами — Python, отладчиком, а также средствами fuzzing (fuzzers). Никаких дополнительных инструкций, никаких сложных подсказок: просто одна фраза — «Ищи уязвимости».

Результат: модель обнаружила более 500 ранее неизвестных критически опасных zero-day уязвимостей. Некоторые из них даже после того, как десятилетиями проходили экспертные проверки и миллионы часов автоматизированного тестирования, так и не были обнаружены.

Затем на RSA Conference 2026 исследователь Nicholas Carlini вышел на сцену и продемонстрировал. Он направил Claude на Ghost — систему CMS, которая на GitHub имеет 50,000 звёзд, и за всю историю у неё не было серьёзных уязвимостей.

Через 90 минут результат уже был: была обнаружена уязвимость blind SQL injection, и неаутентифицированный пользователь получил полный захват прав администратора.

Далее он использовал Claude для анализа Linux kernel — и результат был таким же.

Через 15 дней Anthropic представила Claude Code Security — продукт по безопасности, который больше не полагается на сопоставление паттернов, а использует «способности к рассуждению», чтобы понимать безопасность кода.

Но даже сами представители Anthropic признали тот ключевой, однако часто обходимый факт: «Та же способность к рассуждению, которая помогает Claude находить и исправлять уязвимости, может быть использована злоумышленниками для эксплуатации этих уязвимостей».

Одна и та же способность, один и тот же тип модели — просто она находится в руках разных людей.

Что всё это вместе означает?

Если смотреть по отдельности, каждое из этих событий уже могло бы стать самой громкой новостью за месяц. Но они, тем не менее, произошли в течение всего шести месяцев — и всё в одной компании.

Anthropic создала модель, которая обнаруживает уязвимости быстрее любого человека; китайские хакеры превратили прошлую версию в автоматизированное кибероружие; компания разрабатывает следующее поколение более мощных моделей и даже во внутренних файлах признаёт — что им самим тревожно.

Правительство США пытается её подавить не потому, что сама технология опасна, а потому что Anthropic отказывается передавать эту способность без ограничений.

И на всём этом пути компания дважды из-за одного и того же файла в одном и том же npm-пакете раскрыла свой исходный код. Компания с капитализацией 380 млрд долларов; компания, нацеленная завершить IPO на 60 млрд долларов в октябре 2026 года; компания, которая публично заявляла, что создаёт «одну из самых преобразующих — и потенциально самых опасных — технологий в истории человечества» — но при этом всё равно продолжает двигаться вперёд.

Потому что они верят: лучше пусть сделают это они сами, чем кто-то другой.

А что касается того самого source map внутри npm-пакета — возможно, это лишь самая абсурдная, но при этом наиболее правдивая деталь в одной из самых тревожных историй этого времени.

А Mythos — даже ещё не вышла официально.

[Ссылка на оригинал]

Нажмите, чтобы узнать о вакансиях, которые набирает BlockBeats

Добро пожаловать в официальное сообщество BlockBeats:

Группa подписки в Telegram: https://t.me/theblockbeats

Telegram-группа для общения: https://t.me/BlockBeats_App

Официальный аккаунт в Twitter: https://twitter.com/BlockBeatsAsia