# 私のことを見ないでください都市の監視カメラは、長い間、人工知能を搭載したシステムに取って代わられています。残念ながら、または幸いにも、多くの人が以前はディストピア的な小説でしか読めなかった事実を受け入れざるを得なくなっています。大都市の街角における監視システムの仕組みと、その普及を急いだ国家の理由について、クシシュトフ・シュパクが解説します。## Flock警察2025年9月、デンバーのクリサンナ・エルザーの自宅の前に、裁判通知書を持った警察官が立っていました。被告人は隣町からの荷物を盗んだとして告発されていました。犯罪の証拠として示されたのは、商業企業Flock Safetyの自動監視システムの映像データで、そこにはエルザーの車が映っていました。しかし、警官は被告人にこれらの詳細を共有しませんでした。すべての異議申し立ては裁判で提出するように促されました。> > *「私たちの街にはカメラがあることをご存知でしょう。私たちの知らないところで新鮮な空気を吸うこともできません」* と警官は説明しました。> > 自分の無罪を確信していたエルザーは、自ら証拠を集め始めました。事件当日、彼女は確かに近くにいて、仕立て屋を訪れていましたが、他人の荷物を盗んだことはありません。彼女はスマートフォンや車のGPSトラッカーのデータ、ドライブレコーダーの映像記録、証言、さらには事件当日に着ていた服の写真まで収集しました。何度も警察に情報を渡そうと試みたものの失敗し、被告人は直接警察署長に連絡を取りました。署長は彼女の努力を称賛し、裁判通知書は取り消されたと伝えました。2025年12月時点で、Flock Safetyはアメリカ49州の8万台のカメラへのアクセスを提供していました。## モニター付きバンから犯罪予測へ街角や店舗、公共施設の監視カメラは、もはや珍しいものではありません。しかし、最新のスマートカメラと情報処理技術は、従来のものと比べて全く新しい次元を示しています。### アナログ時代のCCTVかつて、監視システム(CCTV、Closed-circuit television)とは、閉じたネットワークのカメラ群を指し、その映像はショッピングモールの監視員の前の複数のモニターに映し出されていました。技術的には、映像センサー、モニター、記録装置に限定されていました。警察や軍は、少なくとも20世紀半ばから監視システムの実験を行ってきました。1960年、ロンドンのトラファルガー広場で英国警察が行った監視カメラの試験。タイ王室の訪問に合わせて設置されたもので、モニターは車両のそばのバンの中に置かれました。この経験でいくつかの技術的問題が明らかになり、反応はさまざまでした。1979年、英国の警察科学開発局は、当時利用可能だった光学文字認識(OCR)技術を基にしたANPR(自動ナンバープレート認識)技術を開発しました。1990年代には、交差点や建物の外壁に設置されたカメラが標準となり、警察はCCTVとANPRを日常的なツールとして活用し始めました。### スマートカメラコンピュータ部品の小型化と、インターネットを介した「つながり」の拡大、そしてAIの登場により、従来のCCTVに代わるスマートカメラが登場しました。この種のデバイスは、OSを搭載したプロセッサ、記憶装置、ローカルおよびインターネット接続用のインターフェースを備え、場合によっては音声記録用のマイクも搭載しています。Flock SafetyのANPR機能搭載カメラ。出典:Wikimedia 一部のメーカーは、リアルタイムデータ処理のためにAIアクセラレータやNPU(ニューラルプロセッシングユニット)を内蔵し、デバイス上で処理を行います。ほかのメーカーは、外部のハードウェアを用いてAI解析を行います。これらのシステムは、対象物の識別、ナンバーや顔の認識、見た映像の概要作成を可能にします。機能の範囲は、ソフトウェアの設定やハードウェアの選択によって異なります。### 裏側の超脳スマートカメラは、対象物の認識や識別子(車のナンバー、顔、歩き方の特徴)を記録するだけでなく、分析センターがカメラからのデータを収集し、他の情報源と照合し、オペレーターに結果を送る仕組みになっています。Flock Safetyは、「Nova」というプラットフォームを提供しており、これには監視カメラの映像だけでなく、情報漏洩、データブローカーのデータ、その他商業的に入手可能な情報も含まれています。このシステムは、移動経路、嗜好、閲覧履歴、習慣、警察記録、その他のデータを含む個人のプロフィールを作成します。こうした情報の集合に基づき、AIは人々の行動を予測し、疑わしいと判断した状況をオペレーターに警告します。すでにFlockの顧客はこの機能を利用しています。同社によると、Novaは警察の事件解決を「ワンクリック」で可能にします。一方、批評家はこれを、捜査令状なしの監視やプライバシー侵害の拡大手段と指摘しています。## カラフルな髪型とコード注入多くの人は、大規模な監視に無関心です。彼らにとっては、犯罪を解明・予防するための単なるツールに過ぎません。しかし、すべての人が個人の自由の境界に無関心というわけではありません。スマートカメラとプライバシー保護をめぐる対立は、いくつかの側面で展開しています。国家レベルの法的闘争に加え、愛好者たちはカモフラージュ技術や伝統的なハッキング手法に頼っています。### スプーフィング最も興味深い攻撃手法は、スプーフィング、または「プレゼンテーション攻撃」と呼ばれるものです。これは、カメラが受け取る映像に対して行う操作の総称です。マスク、反射材、特殊なテクスチャーなどを用いて、映像を「台無しに」し、システムが対象物を正しく認識できないようにします。2016年、デザイナーのスコット・アーバンが提案したReflectaclesは、赤外線反射レンズを備えた眼鏡で、監視カメラの赤外線照明を反射させ、顔の映像を妨害します。監視カメラの映像に映るReflectacles。出典:Kickstarter このバイパス技術は、単一のカメラには効果的ですが、複数の角度からの監視には不十分です。ベルリンの研究者・アーティストのアダム・ハーヴィーは、顔認識システムに対抗するCV Dazzle(視覚妨害)技術を開発しました。2010年代の例では、非対称の髪型やメイクアップを用いて、当時流行していたViola-Jonesアルゴリズムを欺くことを狙いました。このアルゴリズムは、目の下や鼻の影、対称性、鼻筋の位置から顔を認識します。解決策として、アーティストは、影の配置や肌の色と対照的な色彩を用いて、顔の特徴を隠す方法を採用しました。CV Dazzle Look 5。出典:Adam.harvey.studio。AI顔認識システムの登場により、従来の手法は時代遅れとなり、2020年にはハーヴィーは新たなメイクアップ技術を提案しました。CV Dazzle Look 6と7。出典:Adam.harvey.studio。彼は、これらはあくまで技術のデモンストレーションであり、最適な方法は観察条件に依存すると述べています。同様の手法は、ナンバープレート認識システムにも適用可能です。アメリカのエンスージアスト、ベン・ジョーダンは、ANPR(自動ナンバープレート認識)用の「敵対的」テクスチャを作成する方法を記述しています。公開されている認識モデルを用いて、ジョーダンはニューラルネットにノイズを生成させ、それをナンバープレートに重ねることで、誤った文字を読み取らせたり、全くナンバーを認識させなくしたりします。視覚的な妨害手法の問題点は、その信頼性の低さにあります。効果は条件やカメラの数に依存し、また、監視システムの提供者は、歩き方や車の色、外観の個別の改造といった特徴も識別に利用し始めています。研究者たちは、進化したモデルを回避する方法を模索し続けていますが、より明白な脅威はハッカーによる攻撃です。### デバイスのハッキングとネットワーク攻撃インターネットに接続されたコンピュータと同様に、AIの有無に関わらず、スマートカメラやそのサーバーインフラはハッキングの対象となり得ます。これまでに、多くの脆弱性が記録されています。2021年、Hikvisionの監視カメラのコードにコードインジェクションの脆弱性が発見されました。これにより、完全な制御権を奪取し、ソフトウェアのインストールやネットワーク内の他のカメラへのアクセスが可能になりました。2023年、AxisのカメラのOSに、ACAPアプリのインストール中に任意のコマンドを実行できる脆弱性が見つかりました。2025年、Dahuaの監視システムには、リモートコマンド実行とバッファオーバーフローの脆弱性が2つ発見され、攻撃者はカメラを完全に制御できる状態になっていました。攻撃のもう一つの経路は、屋外の公共場所に設置された機器への直接アクセスです。攻撃者は、メンテナンス用インターフェースを悪用し、ローカルストレージにアクセスしたり、デバイスを改ざんしたりできます。これらから守るために、メーカーはデータの暗号化や、ソフトウェアのハードウェア認証、動画ファイルへの暗号署名を導入しています。適切なセキュリティ対策を施したデバイスは、簡単に「再プログラム」されたり、データをダウンロードされたりすることはありませんが、時にはミスもあります。2025年、404 Mediaは、Flock SafetyのCondorブランドの人追跡機能付きAIカメラの少なくとも60台が不正アクセスの危険にさらされていたと報じました。サイバーセキュリティの専門家ジョン・ゲインズと、前述の研究者ベン・ジョーダンは、Shodanという検索エンジンを使ってこれらのデバイスのIPアドレスを特定し、ログイン情報なしでアクセスできることを発見しました。Flockの監視カメラの映像に映る誰でも、ライブストリームの閲覧、過去30日間のアーカイブデータのダウンロード、設定変更、システムログの閲覧が可能でした。同社は、「設定ミスによる限定的なデバイスの問題」と説明し、問題は解決済みとしています。また、別のモデルのカメラは、特定のボタン操作によってWi-Fiアクセスポイントを開放し、完全なコントロールを可能にしていたことも判明しました。ゲインズは、これらの脆弱性とその他の問題について詳細な分析を55項目にわたりまとめたドキュメントを公開しました。公式声明では、「これらの問題は既知のものであり、潜在的なハッカーはカメラへの直接アクセスと『深い内部知識』に依存している」と述べられています。メーカーは、すべての必要なアップデートは自動的に提供されており、システムの安全性に脅威はないと強調しています。## 「部分的に有能な者」との闘いAIを導入した自動監視システムは、警察にとって便利なツールとなっています。メーカーは、被疑者の車や移動経路、住所などの情報を提供し、事件解決を容易にすると約束します。これに慣れると、過信しやすくなるのも人間の性です。自動化されたシステムの情報に過度に依存し、誤った判断を下す危険性もあります。AIを用いた自動化は、同じ原則に従います。多くのユーザーは、ChatGPTの回答を正しいと信じ、矛盾点を無視しがちです。これが日常生活において誤解や精神的な混乱を引き起こすこともあります。完璧なエンジニアリングと完全なオペレーターの監督下でも、広範なAI分析を伴う監視システムは、害をもたらす可能性があります。2025年、米国当局は、Flock Safetyの技術を違法な監視に利用した疑いで調査を開始しました。移民の追跡や、州境を越える女性の監視に使われていたと疑われています。この場合、システムは正常に動作し、誰も自動検出器を騙したり、カメラをハッキングしたり、映像をディープフェイクで差し替えたりはしていません。## 壊すのではなく、改善をCCTVシステムはすでに広く普及しています。AIを活用した監視システムの導入は、新たな現実です。最も高度なマスクやナンバープレートの隠蔽も、データ収集の全体的な流れを止めることはできません。強力なツールである以上、AI監視システムは、違法行為や安全性の軽視を防ぐための規制が必要です。

私を見ないでください - ForkLog: 暗号通貨、AI、シンギュラリティ、未来

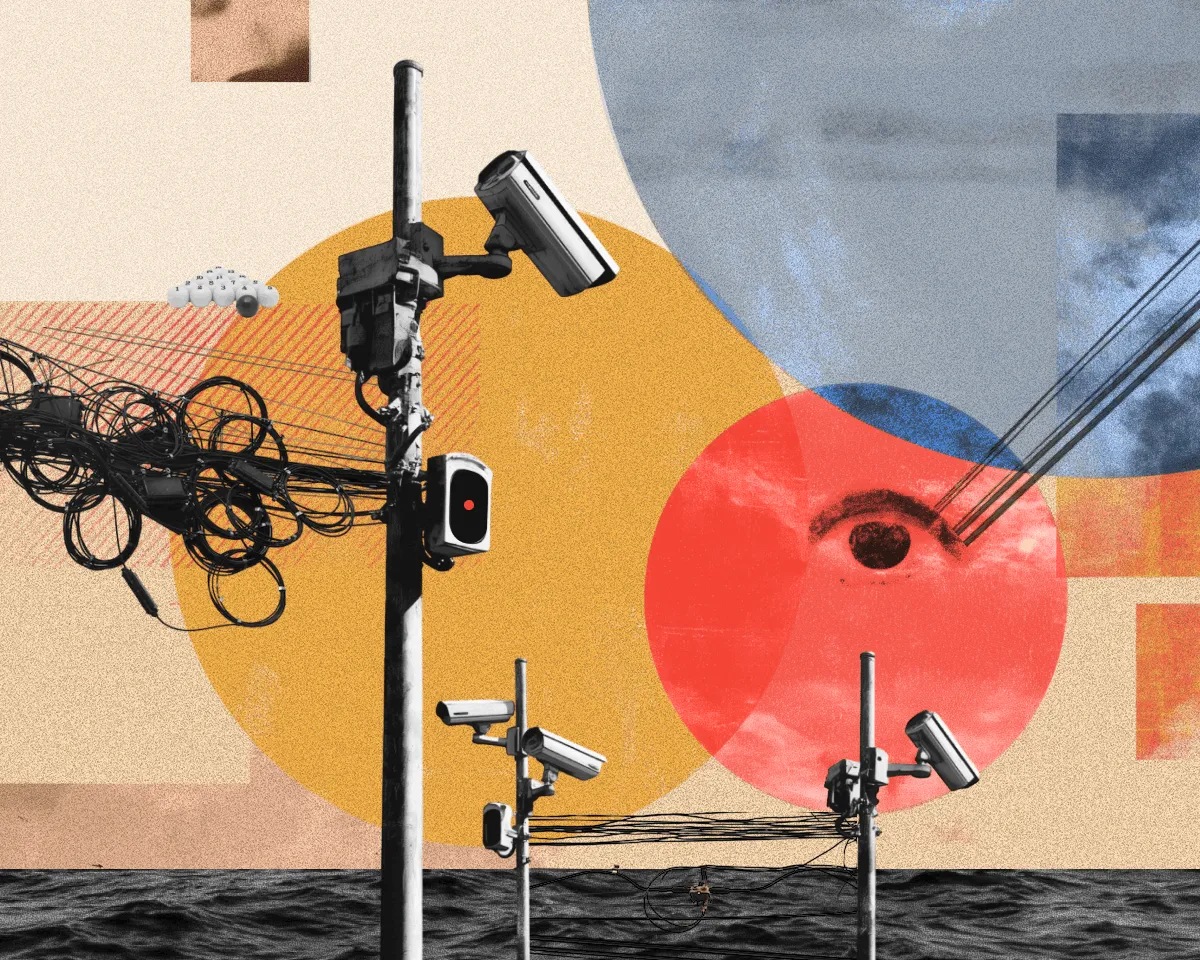

都市の監視カメラは、長い間、人工知能を搭載したシステムに取って代わられています。残念ながら、または幸いにも、多くの人が以前はディストピア的な小説でしか読めなかった事実を受け入れざるを得なくなっています。

大都市の街角における監視システムの仕組みと、その普及を急いだ国家の理由について、クシシュトフ・シュパクが解説します。

Flock警察

2025年9月、デンバーのクリサンナ・エルザーの自宅の前に、裁判通知書を持った警察官が立っていました。被告人は隣町からの荷物を盗んだとして告発されていました。

犯罪の証拠として示されたのは、商業企業Flock Safetyの自動監視システムの映像データで、そこにはエルザーの車が映っていました。しかし、警官は被告人にこれらの詳細を共有しませんでした。すべての異議申し立ては裁判で提出するように促されました。

自分の無罪を確信していたエルザーは、自ら証拠を集め始めました。事件当日、彼女は確かに近くにいて、仕立て屋を訪れていましたが、他人の荷物を盗んだことはありません。

彼女はスマートフォンや車のGPSトラッカーのデータ、ドライブレコーダーの映像記録、証言、さらには事件当日に着ていた服の写真まで収集しました。

何度も警察に情報を渡そうと試みたものの失敗し、被告人は直接警察署長に連絡を取りました。署長は彼女の努力を称賛し、裁判通知書は取り消されたと伝えました。

2025年12月時点で、Flock Safetyはアメリカ49州の8万台のカメラへのアクセスを提供していました。

モニター付きバンから犯罪予測へ

街角や店舗、公共施設の監視カメラは、もはや珍しいものではありません。しかし、最新のスマートカメラと情報処理技術は、従来のものと比べて全く新しい次元を示しています。

アナログ時代のCCTV

かつて、監視システム(CCTV、Closed-circuit television)とは、閉じたネットワークのカメラ群を指し、その映像はショッピングモールの監視員の前の複数のモニターに映し出されていました。

技術的には、映像センサー、モニター、記録装置に限定されていました。

警察や軍は、少なくとも20世紀半ばから監視システムの実験を行ってきました。

1979年、英国の警察科学開発局は、当時利用可能だった光学文字認識(OCR)技術を基にしたANPR(自動ナンバープレート認識)技術を開発しました。

1990年代には、交差点や建物の外壁に設置されたカメラが標準となり、警察はCCTVとANPRを日常的なツールとして活用し始めました。

スマートカメラ

コンピュータ部品の小型化と、インターネットを介した「つながり」の拡大、そしてAIの登場により、従来のCCTVに代わるスマートカメラが登場しました。

この種のデバイスは、OSを搭載したプロセッサ、記憶装置、ローカルおよびインターネット接続用のインターフェースを備え、場合によっては音声記録用のマイクも搭載しています。

これらのシステムは、対象物の識別、ナンバーや顔の認識、見た映像の概要作成を可能にします。機能の範囲は、ソフトウェアの設定やハードウェアの選択によって異なります。

裏側の超脳

スマートカメラは、対象物の認識や識別子(車のナンバー、顔、歩き方の特徴)を記録するだけでなく、分析センターがカメラからのデータを収集し、他の情報源と照合し、オペレーターに結果を送る仕組みになっています。

Flock Safetyは、「Nova」というプラットフォームを提供しており、これには監視カメラの映像だけでなく、情報漏洩、データブローカーのデータ、その他商業的に入手可能な情報も含まれています。

このシステムは、移動経路、嗜好、閲覧履歴、習慣、警察記録、その他のデータを含む個人のプロフィールを作成します。

こうした情報の集合に基づき、AIは人々の行動を予測し、疑わしいと判断した状況をオペレーターに警告します。すでにFlockの顧客はこの機能を利用しています。

同社によると、Novaは警察の事件解決を「ワンクリック」で可能にします。

一方、批評家はこれを、捜査令状なしの監視やプライバシー侵害の拡大手段と指摘しています。

カラフルな髪型とコード注入

多くの人は、大規模な監視に無関心です。彼らにとっては、犯罪を解明・予防するための単なるツールに過ぎません。しかし、すべての人が個人の自由の境界に無関心というわけではありません。

スマートカメラとプライバシー保護をめぐる対立は、いくつかの側面で展開しています。

国家レベルの法的闘争に加え、愛好者たちはカモフラージュ技術や伝統的なハッキング手法に頼っています。

スプーフィング

最も興味深い攻撃手法は、スプーフィング、または「プレゼンテーション攻撃」と呼ばれるものです。これは、カメラが受け取る映像に対して行う操作の総称です。

マスク、反射材、特殊なテクスチャーなどを用いて、映像を「台無しに」し、システムが対象物を正しく認識できないようにします。

2016年、デザイナーのスコット・アーバンが提案したReflectaclesは、赤外線反射レンズを備えた眼鏡で、監視カメラの赤外線照明を反射させ、顔の映像を妨害します。

ベルリンの研究者・アーティストのアダム・ハーヴィーは、顔認識システムに対抗するCV Dazzle(視覚妨害)技術を開発しました。

2010年代の例では、非対称の髪型やメイクアップを用いて、当時流行していたViola-Jonesアルゴリズムを欺くことを狙いました。このアルゴリズムは、目の下や鼻の影、対称性、鼻筋の位置から顔を認識します。

解決策として、アーティストは、影の配置や肌の色と対照的な色彩を用いて、顔の特徴を隠す方法を採用しました。

同様の手法は、ナンバープレート認識システムにも適用可能です。アメリカのエンスージアスト、ベン・ジョーダンは、ANPR(自動ナンバープレート認識)用の「敵対的」テクスチャを作成する方法を記述しています。

公開されている認識モデルを用いて、ジョーダンはニューラルネットにノイズを生成させ、それをナンバープレートに重ねることで、誤った文字を読み取らせたり、全くナンバーを認識させなくしたりします。

視覚的な妨害手法の問題点は、その信頼性の低さにあります。効果は条件やカメラの数に依存し、また、監視システムの提供者は、歩き方や車の色、外観の個別の改造といった特徴も識別に利用し始めています。

研究者たちは、進化したモデルを回避する方法を模索し続けていますが、より明白な脅威はハッカーによる攻撃です。

デバイスのハッキングとネットワーク攻撃

インターネットに接続されたコンピュータと同様に、AIの有無に関わらず、スマートカメラやそのサーバーインフラはハッキングの対象となり得ます。

これまでに、多くの脆弱性が記録されています。

2021年、Hikvisionの監視カメラのコードにコードインジェクションの脆弱性が発見されました。これにより、完全な制御権を奪取し、ソフトウェアのインストールやネットワーク内の他のカメラへのアクセスが可能になりました。

2023年、AxisのカメラのOSに、ACAPアプリのインストール中に任意のコマンドを実行できる脆弱性が見つかりました。

2025年、Dahuaの監視システムには、リモートコマンド実行とバッファオーバーフローの脆弱性が2つ発見され、攻撃者はカメラを完全に制御できる状態になっていました。

攻撃のもう一つの経路は、屋外の公共場所に設置された機器への直接アクセスです。攻撃者は、メンテナンス用インターフェースを悪用し、ローカルストレージにアクセスしたり、デバイスを改ざんしたりできます。

これらから守るために、メーカーはデータの暗号化や、ソフトウェアのハードウェア認証、動画ファイルへの暗号署名を導入しています。

適切なセキュリティ対策を施したデバイスは、簡単に「再プログラム」されたり、データをダウンロードされたりすることはありませんが、時にはミスもあります。

2025年、404 Mediaは、Flock SafetyのCondorブランドの人追跡機能付きAIカメラの少なくとも60台が不正アクセスの危険にさらされていたと報じました。

サイバーセキュリティの専門家ジョン・ゲインズと、前述の研究者ベン・ジョーダンは、Shodanという検索エンジンを使ってこれらのデバイスのIPアドレスを特定し、ログイン情報なしでアクセスできることを発見しました。

Flockの監視カメラの映像に映る誰でも、ライブストリームの閲覧、過去30日間のアーカイブデータのダウンロード、設定変更、システムログの閲覧が可能でした。

同社は、「設定ミスによる限定的なデバイスの問題」と説明し、問題は解決済みとしています。

また、別のモデルのカメラは、特定のボタン操作によってWi-Fiアクセスポイントを開放し、完全なコントロールを可能にしていたことも判明しました。

ゲインズは、これらの脆弱性とその他の問題について詳細な分析を55項目にわたりまとめたドキュメントを公開しました。

公式声明では、「これらの問題は既知のものであり、潜在的なハッカーはカメラへの直接アクセスと『深い内部知識』に依存している」と述べられています。

メーカーは、すべての必要なアップデートは自動的に提供されており、システムの安全性に脅威はないと強調しています。

「部分的に有能な者」との闘い

AIを導入した自動監視システムは、警察にとって便利なツールとなっています。

メーカーは、被疑者の車や移動経路、住所などの情報を提供し、事件解決を容易にすると約束します。

これに慣れると、過信しやすくなるのも人間の性です。自動化されたシステムの情報に過度に依存し、誤った判断を下す危険性もあります。

AIを用いた自動化は、同じ原則に従います。多くのユーザーは、ChatGPTの回答を正しいと信じ、矛盾点を無視しがちです。これが日常生活において誤解や精神的な混乱を引き起こすこともあります。

完璧なエンジニアリングと完全なオペレーターの監督下でも、広範なAI分析を伴う監視システムは、害をもたらす可能性があります。

2025年、米国当局は、Flock Safetyの技術を違法な監視に利用した疑いで調査を開始しました。移民の追跡や、州境を越える女性の監視に使われていたと疑われています。

この場合、システムは正常に動作し、誰も自動検出器を騙したり、カメラをハッキングしたり、映像をディープフェイクで差し替えたりはしていません。

壊すのではなく、改善を

CCTVシステムはすでに広く普及しています。AIを活用した監視システムの導入は、新たな現実です。

最も高度なマスクやナンバープレートの隠蔽も、データ収集の全体的な流れを止めることはできません。

強力なツールである以上、AI監視システムは、違法行為や安全性の軽視を防ぐための規制が必要です。